服务中心集群的数据一致性问题

随着企业业务的快速扩张,单一服务中心已无法满足高并发、高可用的需求,服务中心集群架构应运而生。在分布式环境下,数据一致性问题成为服务中心集群面临的核心挑战。

数据一致性问题的表现形式

- 数据更新延迟:由于网络延迟和节点间同步时间差,不同节点可能在短时间内持有不同版本的数据

- 并发写冲突:多个客户端同时向不同节点写入数据时,可能导致数据覆盖或冲突

- 节点故障导致数据丢失:在数据同步过程中,若主节点发生故障,可能造成部分数据未同步到从节点

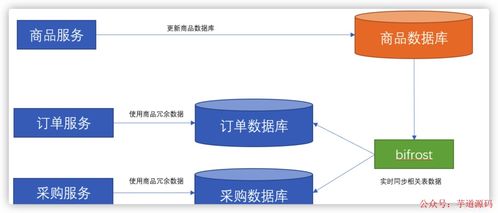

- 跨服务事务不一致:涉及多个微服务的业务操作,可能出现部分成功、部分失败的情况

数据处理服务的应对策略

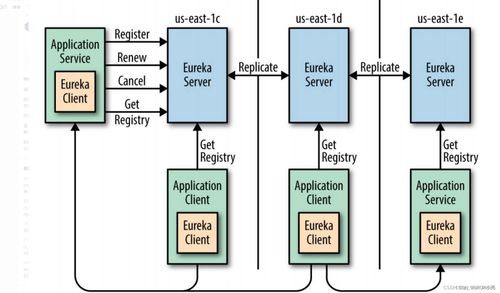

1. 一致性协议应用

- 采用Raft或Paxos算法:确保集群节点在领导者选举和数据复制过程中保持一致

- 实现强一致性:通过两阶段提交(2PC)或三阶段提交(3PC)保证跨节点事务的原子性

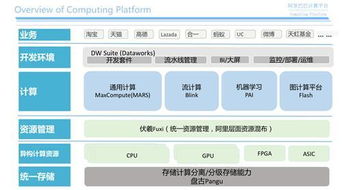

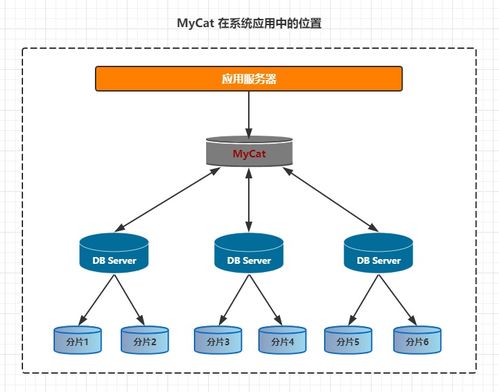

2. 数据分片与路由

- 合理的数据分片策略:根据业务特性将数据分布到不同节点,减少单点压力

- 一致性哈希算法:实现数据动态扩容时的平滑迁移,最小化数据重分布影响

3. 读写分离与缓存机制

- 主从复制架构:写操作集中在主节点,读操作分散到从节点

- 多级缓存策略:结合本地缓存和分布式缓存,在保证数据新鲜度的同时提升性能

4. 事务补偿机制

- Saga模式:将长事务分解为多个本地事务,通过补偿操作处理失败情况

- TCC模式:通过Try-Confirm-Cancel三个阶段保证分布式事务的最终一致性

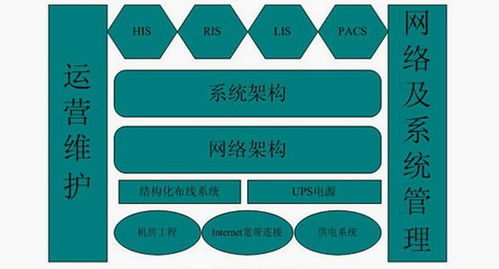

5. 监控与告警体系

- 实时监控数据同步状态:及时发现数据不一致问题

- 建立数据一致性校验机制:定期对比不同节点的数据,确保数据完整性

最佳实践建议

- 根据业务场景选择合适的一致性级别:强一致性、最终一致性或读写一致性

- 设计容错机制:考虑网络分区、节点故障等异常情况的处理

- 实施数据版本控制:通过版本号或时间戳解决并发冲突

- 建立数据回滚能力:在数据出现不一致时能够快速恢复到正确状态

结语

服务中心集群的数据一致性问题是分布式系统设计的核心难点。通过合理的数据处理服务架构设计、一致性协议应用和完善的容错机制,可以在保证系统性能的有效解决数据一致性问题,为业务提供可靠的数据服务支撑。